Level3がGlobal Crossingを取引総額30億ドルで買収

2011年4月11日,Level3はGlobal Crossing(GBLX)を取引総額30億ドルで買収する合意に至ったと発表した.

Global Crossingの評価額19億円に加えてGlobal Crossingの負債11億も含まれているため取引総額は30億ドルに達する.取引は株式交換方式で行われる.

このTier-1によるTier-1の買収によりLevel3は3つの大陸50の国に光ファイバネットワークを持ち,70の国に接続することになる.

「両社の昨年の売上高は、Level 3が36億5100万ドル、Global Crossingが26億900万ドルだが、それぞれ6億2200万ドルと1億7600万ドルの損失を計上している」 (ITproより引用)

WSJによれば,「米国内の光ファイバー回線は稼働率が50%を下回っているほか、インターネットのホールセール価格は過去3年にわたって年間約25%下落している」(ITproより引用)とのこと.

参考資料

Level 3がGlobal Crossingを買収へ、取引総額は約30億ドル | 日経 xTECH(クロステック)

http://japan.internet.com/busnews/20110412/5.html

Level 3がGlobal Crossingを買収へ、取引総額は約30億ドル | 日経 xTECH(クロステック)

http://www.networkworld.com/news/2011/041111-level-3-to-acquire-global.html

http://www.networkworld.com/news/2011/041111-internet2.html

http://www.networkworld.com/news/2011/041111-level3-global-crossing.html

広島市大の研究グループが超高速衛星回線でTCPの世界最高速度を達成

広島市大は情報科学研究科・石田教授らの研究グループが超高速衛星回線でTCPの世界最高速度281.9Mbpsを達成したと発表した.

衛星回線にはWINDS(衛星)とLET(鹿島宇宙技術センターの大型地球局、送信側)及びSDR-VSAT(超高速小型地球局、受信側)を利用し,TCPには同研究チームが開発したTCP-STARを用いた.これにより従来の最高速度であったNASAの127.8Mbpsを大きく上回る281.9Mbpsを達成することに成功した.

TCP-STARは超高速衛星回線用のTCP輻輳制御アルゴリズムであり,3つのメカニズムで構成されている.

- Congestion Window Setting (CWS): 利用可能帯域に基づいた輻輳ウィンドウ設定のメカニズム.ビットエラーによるデータロスで引き起こされる転送量の低下に耐えることができる.

- Lift Window Control (LWC): 推定された利用可能帯域に基づいて輻輳ウィンドウを迅速に大きくするメカニズム.

- Acknowledgment Error Notification (AEN): 遅延やACKロスによる再送ミスによって引き起こされるスループットの低下を避けるメカニズム.

衛星回線のようなセグメントロスの発生する環境で他のアルゴリズムより高速に通信ができるということだ.

Facebookが高効率なデータセンターの仕様を公開 Open Compute Project 発足

2011年04月07日,Facebookはパロアルトの本社で開催されたプレスイベントで,同社で培われてきたサーバ効率化技術を公開するOpen Compute Projectの発足を発表した.

Facebookでは最初の自前のデータセンターをOregon州Prinevilleに設立し,データセンターのイノベーションに成功したという.はこの10年間で他社の開発した数々の技術的恩恵を受けているため,同社がデータセンターの開発と運用で積み重ねた経験とノウハウを詳細に公開することで貢献し,公開によるテクノロジーのさらなる発展で再度同社が利益を得ることを望んでいるようだ.

要点

Oregon州Prinevilleのデータセンター

- 1万3700平方メートル

- 稼働率99.9999%

- PUE1.07

- 業界平均1.5

- エネルギー効率38%アップ

- コスト24%ダウン

- 現在2つ目のデータセンターをNorth Carolinaに建設中

- 3人のサーバエンジニアが開発

冷却・空調

- 外気冷却

- エアコン(冷媒,コンプレッサー,空調配管)なし

- 霧を噴射して水の気化熱で冷却

- 外気が低すぎるときは内部の暖かい空気と混合

- 調整エリアとフィルターシステムを通ってサーバに降下

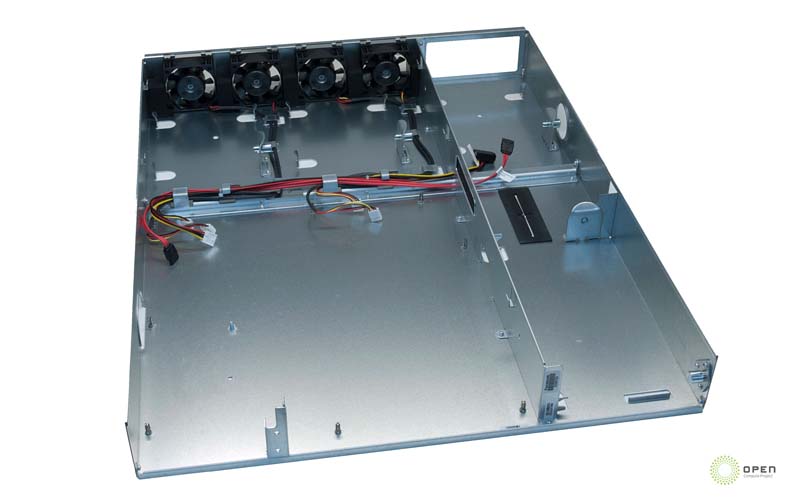

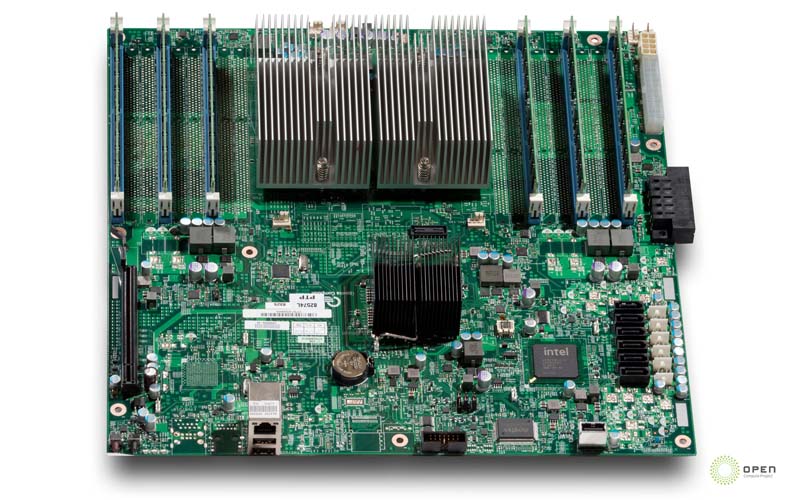

シャーシ・筐体

- 独自設計

- 前面や上面のカバーがないオープンな構造

- 部品の交換が用意になる

- 材料を22%減らすことに成功

- サイズは幅480mm高さ66mm(約1.5U)

- 大きめのヒートシンクとファンのため

- "vanity-free server"

- 無駄を排除した飾りのないサーバ

- ネジをも排除

電源

温度管理

ラック

バックアップバッテリ

照明

- モーションセンサーで人を感知して点灯するLED照明

Open Compute Project

- 技術仕様やCADを公開

- サーバー

- 電力供給

- サーバラック

- 電源バックアップシステム

- 建築設計

参考資料

Facebook、最新データセンターの秘密を公開―「ファイトクラブみたいに扱ってはいけない」 | TechCrunch Japan

Facebookの「Open Compute Project」:サーバー/データセンターのノウハウをオープン化 | TechCrunch Japan

Facebookが高効率データセンターの技術を公開、「Open Compute Project」発足 | 日経 xTECH(クロステック)

Facebook、自社データセンターの仕様をオープンソース化 - ITmedia NEWS

Facebook、自社の高効率データセンター技術を「Open Compute Project」で公開 -INTERNET Watch Watch

http://journal.mycom.co.jp/news/2011/04/08/010/index.html

Facebook、経済効率抜群のデータセンターの技術をオープンにする | スラド オープンソース

Facebookのデータセンター公開! 青の魅力がたっぷりです | ギズモード・ジャパン

Facebook最新データセンターの中身 (1/2):クラウドHot Topics(3) - @IT

Verisignが.com TLDをDNSSECに対応

Googleの超高速ブロードバンド実験地域はカンザスに

2011年03月30日,Googleは1Gbpsの超高速ブロードバンド実験の最初の地域としてカンザスシティを選定したと発表した.2012年第1四半期にサービスの提供開始を予定している.

コメント

このプロジェクトの本当の目論見はまだわからないのだけど,表向きにはこういうことを言っている.

- Next generation apps: We want to see what developers and users can do with ultra high-speeds, whether it's creating new bandwidth-intensive "killer apps" and services, or other uses we can't yet imagine.

- New deployment techniques: We'll test new ways to build fiber networks, and to help inform and support deployments elsewhere, we'll share key lessons learned with the world.

- Openness and choice: We'll operate an "open access" network, giving users the choice of multiple service providers. And consistent with our past advocacy, we'll manage our network in an open, non-discriminatory and transparent way.

WIDEの研究会で会場のアクセス回線の都合から1Mbpsも出ない輻輳だらけの回線を経験したのだけど,その時はAjaxバリバリのGoogleとか使い物にならなかったなぁ.